Habla un teórico de la mayor Conspiración de la Historia

.

.

.

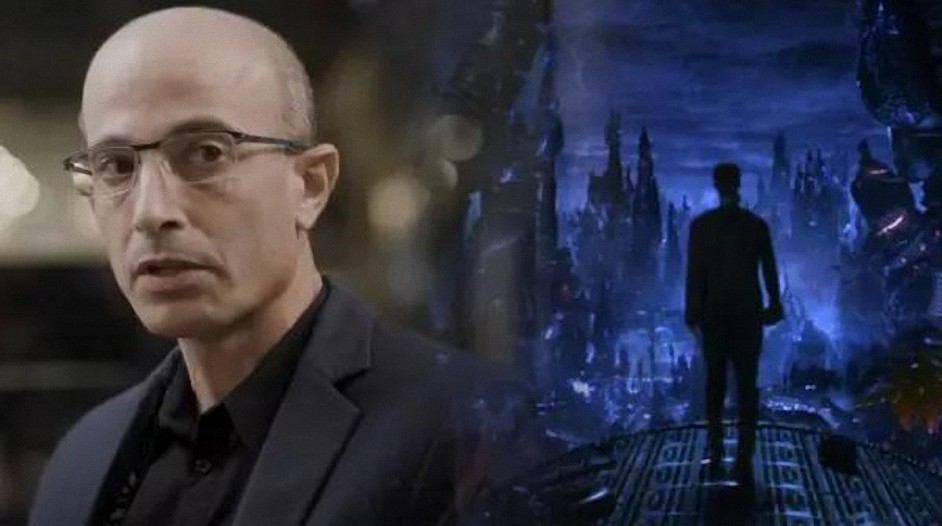

«La inteligencia artificial es el final de la Historia humana», dice Yuval Harari.

.

La declaración fue hecha por Yuval Noah Harari, un Historiador, Escritor y Profesor israelí, que es conocido por su trabajo en el campo de la divulgación científica.

Harari se ha destacado por su habilidad para comunicar temas complejos de manera accesible. Y por su capacidad para analizar cuestiones relacionadas con la Historia, la Tecnología y la Evolución humana. Teniendo esto en cuenta, recientemente fue entrevistado para The Economist sobre el fututo de la Inteligencia Artificial (IA). Y lo que dijo suena como una advertencia para nuestra especie.

«La IA es el final de la Historia humana. No el final de la Historia, sino el final de la Historia dominada por el humano», dijo el Profesor en respuesta a los vertiginosos avances que se esperan de esta Tecnología emergente en los próximos años. «La Historia continuará, pero con alguien más en el control».

Para explicar esto, posteriormente recurrió a una interesante analogía.

«Tiendo más a pensar en términos de una invasión alienígena. Como una flota de naves espaciales provenientes del planeta Zircon o como quieras llamarlo, con seres altamente inteligentes, que estarán aquí en cinco años y conquistarán el planeta. Tal vez eso sea bueno, con su inteligencia podrían resolver problemas como el cáncer o el cambio climático, pero no estamos seguros».

«Esto es lo que estamos enfrentando, a excepción de que los alienígenas no están viniendo en naves espaciales del planeta Zircon, sino del Laboratorio», añadió.

El Historiador también resaltó que estamos viviendo un momento sin precedentes en la historia de nuestra especie. En el cual nos enfrentamos de manera colectiva a algo con la capacidad de generar ideas y superarnos.

«Sabemos que la IA va a llegar a ser altamente inteligente. Que tiene el potencial de adquirir conciencia y voluntad propia. Y esa es una mezcla peligrosa. Algo a lo que nunca nos habíamos enfrentado antes. Las bombas atómicas no tenían el potencial de tener voluntad. Tampoco la primera imprenta. Pero esto, sí».

Para evitar que las IAs nos quiten el control, Harari propone crear Instituciones nuevas y confiables que las regulen de manera estricta. Ya que por el momento solo las Compañías detrás de esta Tecnología saben realmente lo que está sucediendo. No los Gobiernos.

«Al igual que se reguló la falsificación de dinero, para evitar un caos financiero, se debe regular la falsificación humana por parte de la IA», concluyó.

A continuación, la entrevista completa, donde además participó el experto en IA Mustafa Suleyman, creando interesantes contrapuntos:

Por MysteryPlanet.com.ar.

Visto en: Maestroviejo

.

Comentario de esta Casa.

.

¿Será una casualidad? Nos referimos al ejemplo que ha puesto el personaje israelí: «una invasión alienígena … una flota de naves espaciales … estarán aquí en cinco años y conquistarán el planeta.» Apostaríamos que no, que no es una casusualidad. Ahora, en estos dos meses últimos, se ha desatado una fiebre en medios oficiales de mencionar a extraterrestres.

Primero fueron tres oficiales o ex-oficiales del Ejército estadounidense, que declararon con aplomo ante el Congreso sobre ovnis y seres extraterrestres [1]. Casi de inmediato, la grabación de un ex-espía con su muerte próxima, nos habla de holograma de naves espaciales plenamente reales [2]. Un par de días después, la que fuera Secretaria de Werner von Braun exponía las confidencias que éste le hizo en sus últimos días de vida antes de morir de cáncer, cuando ya se sabía condenado [3].

Hemos visto lo sucedido en Lahaina y Maui, en Hawai, donde unos potentes rayos laser procedentes de lo alto destruían viviendas en cuestión de un par de segundos [4]. Y otras voces añadían que lo mismo había sucedido ya en otro par de lugares de Estados Unidos.

Y ahora el Asesor del Foro Económico Mundial para temas de Tecnología nos habla de lo mismo, de los extraterrestres. Suena a predicción. No se le llama «mentalización programada», pero algo parecido. Así cuando suceda ya estaremos preparados, lo habremos oído y lo creeremos más fácilmente.

Y para parecerse más a la realidad, que aquí sospechamos que se prepara, añadió: «los alienígenas no están viniendo en naves espaciales … sino del Laboratorio«.

Y lo pensamos porque siempre representan la misma comedia ante nuestros ojos. El proceso parece que se llama «Acción-Reacción-Solución». Se finge na accióno, Que noe s real, parece real, pero no es rela, Es una tentado de falsa bandera. Ahora ya tiene nombre, se ha repetido docenas de veces, desde el hundimiento del Maine el 15 de Febrero de 1.998. Que tampoco sería el primer simulacro de ataque enemigo, aun siendo causado por los amigos más estrechos, supuestamente también.

El asesinato a distancia de un conocido Presidente USA fue posiblemente un atentado de falsa bandera. Y se le echó la culpa a un inocente, al que a su vez se eliminó.

Sobre los atentados de las Torres Gemelas hay vídeos donde titulados competentes lo achacan a una demolición programada. La desaparición de los restos de las Torres, rumbo a China, resulta inconcebible en una investigación policial normal.

Las «armas de destruccion masiva» de Sadam Hussein, otro planteamiento similar. Para justificar una intervención lucrativa.

Y, más recientemente, la farsa del Kobit, supuso la Acción. El miedo sembrado, la Reacción, también provocada. Y la Solución, unas vacunas que ni se probaron para combatir el problema, debido a la prisa por estar en el mercado, «ya sabes …» Eran el objetivo de todo el montaje. Aunque no cumpieron con su objetivo inicial, porque no se puede liquidar al 90% de la población del planeta. Eso sólo se les ocurre a orates.

Como les están fallando los Planes gestados tras arduas reuniones en Clubs privados, se sinten obligados a acelerarlo todo.

El Foro Economico Mundila programa una reunión de «Brainstorming» (Tomenta de Ideas) para finales de año en Davos. Necesitan nuevas ideas de sus acólitos, para ver si mueven el asunto.

La ONU hace una Declaración para advertir de que los Planes establecidas en «la cosa esa» 2030 sólo se cumplen al 15% y que necesitan 500.000 millones más cada año para enderezar el rumbo.

Las Monedas Digitales Programables del Banco Central parece que no son aceptadas por la población de los países donde se han ensayado, del África. Y ahora sacan un «Libro Mayor Mundial» como solución más rápida y eficaz, tal vez. Y que no haga falta lograr la conformidad de la población. Sería cosa de acordarlo los Bancos, vete tú a saber. Como es un instrumento de Contabilidad …

Las «ciudades de cuarto de hora» están empezando a encontrar problemas, porque algunos disconformes ingleses están pasando a la acción, si bien en pequeña escala.

En consecuencia, no tienen más remedio que adelantar el «Evento extraterrestres», su última ficción, su última farsa. El golpe definitivo. Porque al día siguiente, en la ONU, todos los polítiquillos, corruptos y cómplices, acordarán que toda las naciones se unan en un «Único Gobierno Mundial». Para hacer frente a la falsa invasión extraterreste, inexistente.

Lo de siempre, Acción-Reacción-Solución. Nos «invaden» con hologramas. «Mejor les haremos frente todos unidos». Y nos unimos en el «Nuevo Orden Mundial» en 24 horas. No tienen imaginación para inventar otra cosa.

Siempre la misma cantinela. Lo malo es que tienen que ensayar los rayos laser mortales. Y cuando los ensayan, se les ve. Si pudieran hacer los ensayos en la cara oculta de la Luna, lo harían allí. Pero como todavía no han llegado, porque también lo del «aterrizaje en la Luna» fue cosa de Steven Spielberg … tampoco pueden.

Son cortos de ideas. Las que tiene son todas iguales. Todas fallan, porque no tienen en cuenta los intereses de todas las personas que no son Ellos. Los Planes que preparan tiene el mismo guión: Acción-Reacción-Solución. Nos engañaron con el primero. Pero una y no más, amigos … No se puede hacer nada sensato con Ellos. Tienen que dimitir. O dimitirles directamente, a mano, si se niegan.

[1] «Lo ocultaron«

[2] «Ex-espía habla de hologramas de naves extraterrestres.»

[3] «Un testimonio imprescindible»

.

Habla un teórico de la mayor Conspiración de la Historia Habla un teórico de la mayor Conspiración de la Historia Habla un teórico de la mayor Conspiración de la Historia